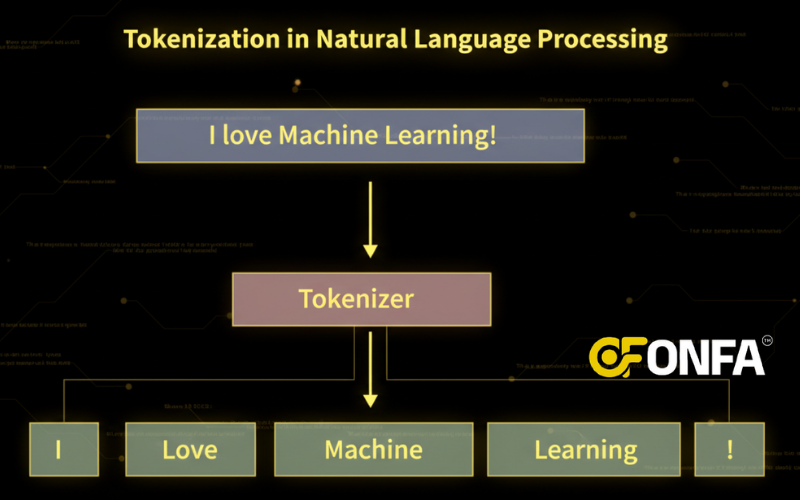

Trong thế giới xử lý ngôn ngữ tự nhiên, không có thuật toán nào hoạt động hiệu quả nếu không có tokenizer. Vậy tokenizer là gì và vì sao nó quan trọng đến vậy? Đây là công cụ giúp biến văn bản thô thành các “token” – đơn vị nhỏ mà mô hình có thể hiểu. Dù bạn làm NLP, AI, lập trình Python hay nghiên cứu blockchain, tokenizer luôn xuất hiện với vai trò nền tảng. Bài viết này sẽ giúp bạn hiểu rõ bản chất, cách hoạt động, các loại phổ biến và cách ứng dụng tokenizer trong thực tế.

Khái niệm Tokenizer

Tokenizer là gì? Tokenizer là công cụ dùng để tách văn bản thành các phần nhỏ hơn gọi là token. Tùy vào loại tokenizer, token có thể là từ, cụm từ, ký tự hoặc đoạn subword.

Mục đích của tokenizer là giúp máy tính “đọc” và “hiểu” dữ liệu văn bản theo một cấu trúc chuẩn hóa. Nó giúp giảm kích thước dữ liệu, xử lý văn bản nhanh hơn và tăng độ chính xác của mô hình NLP, AI, Python hoặc blockchain.

Tokenization hoạt động như thế nào?

Quy trình tokenization tuân thủ theo 3 bước chính:

- Nhận văn bản đầu vào

Đây có thể là câu, đoạn văn, tài liệu hoặc dữ liệu chuỗi. - Ánh xạ văn bản thành token

Tokenizer quét từng ký tự/từ và tách chúng theo quy tắc đã định: dựa theo dấu cách, dấu câu, từ điển subword hoặc thuật toán mã hoá. - Gán mã số (ID) cho token

Mỗi token được chuyển thành ID số để mô hình có thể xử lý.

Dù thuật toán khác nhau, mục tiêu vẫn là biến văn bản thành dữ liệu có cấu trúc.

Các loại Tokenizer phổ biến trong NLP và AI

Word-based Tokenization (tách theo từ)

Loại này tách văn bản dựa trên dấu cách hoặc ký tự đặc biệt. Đây là kỹ thuật cơ bản nhất. Nhược điểm: không xử lý tốt các từ mới, từ ghép, hoặc ngôn ngữ không dấu cách như tiếng Nhật.

Sentence Tokenization

Tokenizer này chia văn bản thành câu dựa vào các dấu câu như “.” “?” “!”.

Ứng dụng nhiều trong phân tích cảm xúc, tóm tắt tài liệu hoặc chatbot.

Character Tokenization

Mỗi ký tự trở thành một token.

Ưu điểm: bao phủ toàn bộ từ mới, từ hiếm.

Nhược điểm: chuỗi token rất dài, xử lý chậm.

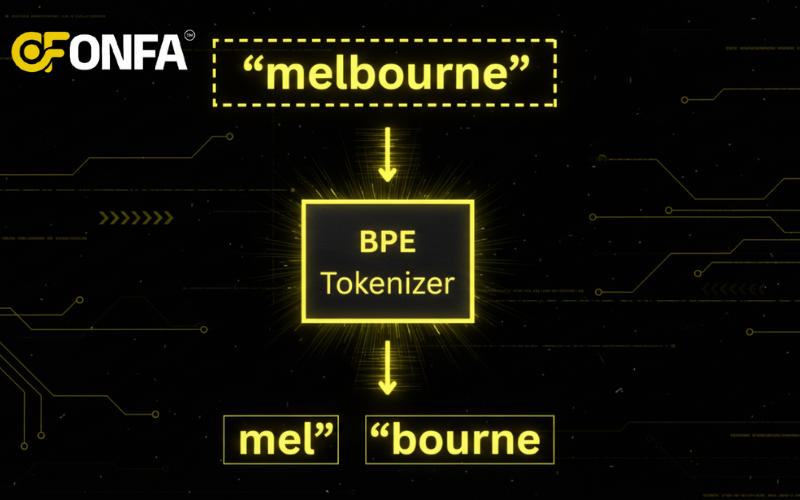

Subword Tokenization

Đây là loại phổ biến nhất trong AI hiện đại.

Các mô hình như GPT, BERT đều dùng subword tokenizer vì nó:

- Hiểu được từ mới bằng cách tách thành phần nhỏ

- Giảm kích thước từ điển

- Hiệu quả cho các ngôn ngữ phức tạp như tiếng Việt

Ví dụ: “học sinh” → “học” + “sinh”.

Tokenizer trong lập trình Python

Python là ngôn ngữ phổ biến nhất để làm NLP. Vì vậy, có rất nhiều thư viện hỗ trợ tokenizer mạnh mẽ.

Sử dụng thư viện phổ biến (NLTK, spaCy, HuggingFace)

NLTK

- Dễ học, phù hợp người mới.

- Có sẵn word tokenizer, sentence tokenizer.

spaCy

- Tốc độ nhanh, thích hợp mô hình sản xuất.

- Tự động nhận dạng câu, từ, entities.

HuggingFace Transformers

- Hỗ trợ các tokenizer hiện đại như BPE, WordPiece.

- Cung cấp sẵn tokenizer cho GPT, BERT, LLaMA…

Cách chọn loại tokenizer phù hợp cho từng use case

| Use Case | Tolenizer phù hợp |

| Chatbot, AI,LLM | Subword (BPE/WordPiece) |

| Phân tích văn bản đơn giản | Word-based |

| Xử lý tiếng Việt | Subword tokenizer |

| Mô hình sâu học ký tự | Character tokenizer |

| Tóm tắt văn bản | Sentence tokenizer |

Tokenizer trong NLP và AI: Ứng dụng thực tế

Tokenizer được dùng trong hầu hết các tác vụ:

- Phân tích cảm xúc

- ChatGPT, GPT-4, GPT-5

- Dịch máy

- Nhận dạng giọng nói

- Tìm kiếm ngữ nghĩa

- Tóm tắt tài liệu

- Nhận diện thực thể (NER)

- Phân loại văn bản

Thiếu tokenizer, các mô hình hoàn toàn không thể hiểu nội dung văn bản.

Vai trò của Tokenizer trong GPT và mô hình ngôn ngữ lớn

Trong GPT, tokenization là bước bắt buộc. GPT không đọc từ mà đọc token.

GPT dùng trình tokenizer dựa trên Byte Pair Encoding (BPE) nhằm:

- Giảm số lượng từ trong từ điển

- Tăng khả năng hiểu từ mới

- Phân tách chính xác văn bản tiếng Việt, tiếng Anh, đa ngôn ngữ

- Hỗ trợ mô hình tạo câu tự nhiên hơn

GPT càng lớn thì tokenizer càng quan trọng. Chỉ cần thay tokenizer, kết quả mô hình có thể thay đổi đáng kể.

Tokenizer trong blockchain và dữ liệu phi cấu trúc

Trong blockchain, dữ liệu không chỉ là số mà còn là văn bản, metadata, smart contract logs, dữ liệu phi cấu trúc…

Tokenization trong blockchain giúp:

- Tách dữ liệu log để phân tích giao dịch

- Chuẩn hóa dữ liệu từ smart contract events

- Xử lý dataset phi cấu trúc cho AI/ML on-chain

- Tối ưu hóa công cụ phân tích dữ liệu blockchain

- Hỗ trợ indexing blockchain (như The Graph)

AI kết hợp blockchain ngày càng phát triển, nên vai trò của tokenizer trong xử lý chuỗi dữ liệu càng lớn.

Ưu điểm và thách thức của Tokenizer

Ưu điểm:

- Chuẩn hóa văn bản

- Tăng độ chính xác của mô hình

- Giảm chi phí xử lý

- Hỗ trợ từ mới, từ hiếm (đặc biệt với subword)

Thách thức:

- Tokenizer không hoàn hảo với mọi ngôn ngữ

- Dữ liệu đa ngôn ngữ gây khó khăn

- Tokenizer sai → mô hình dự đoán sai

- Phải đồng bộ tokenizer với mô hình AI

So sánh giữa các Tokenizer nổi bật

WordPiece vs Byte-Pair Encoding (BPE)

Cả hai đều là subword, nhưng:

- WordPiece dùng xác suất để chọn subword.

- BPE dùng tần suất xuất hiện.

GPT dùng BPE; BERT dùng WordPiece.

Tokenizer trong spaCy vs HuggingFace Transformers

- spaCy: nhanh, nhẹ, phù hợp sản xuất.

- HuggingFace: mạnh, hỗ trợ LLM, nhiều tokenizer pre-trained.

Tokenizer truyền thống và Token-free models (trong tương lai)

Các mô hình token-free như dựa trên state space models hoặc character-level transformers đang phát triển. Chúng không dùng token cố định, giúp mô hình hiểu ngữ nghĩa linh hoạt hơn.

Kết luận

Hiểu tokenizer là gì giúp bạn nắm được nền tảng của NLP, AI, Python và cả blockchain. Từ cách hoạt động, ứng dụng đến vai trò trong GPT, tokenizer ảnh hưởng trực tiếp đến hiệu suất mô hình. Khi chọn đúng tokenizer, hệ thống của bạn sẽ xử lý văn bản nhanh hơn, chính xác hơn và thông minh hơn. Đây là bước quan trọng để xây dựng các ứng dụng AI chất lượng trong tương lai.